SHAP 模型解释可视化应用

目录

SHAP 概念介绍

什么是 SHAP?

SHAP (SHapley Additive exPlanations) 是一个基于博弈论的模型解释框架。它的核心思想来自于博弈论中的 Shapley 值,这个概念最初是用来计算每个玩家在合作博弈中的贡献。在机器学习中,我们可以把特征看作"玩家",预测结果看作"游戏收益"。

SHAP 的工作原理

SHAP 的可视化方法

1. Summary Plot(摘要图)

条形图版本

散点图版本

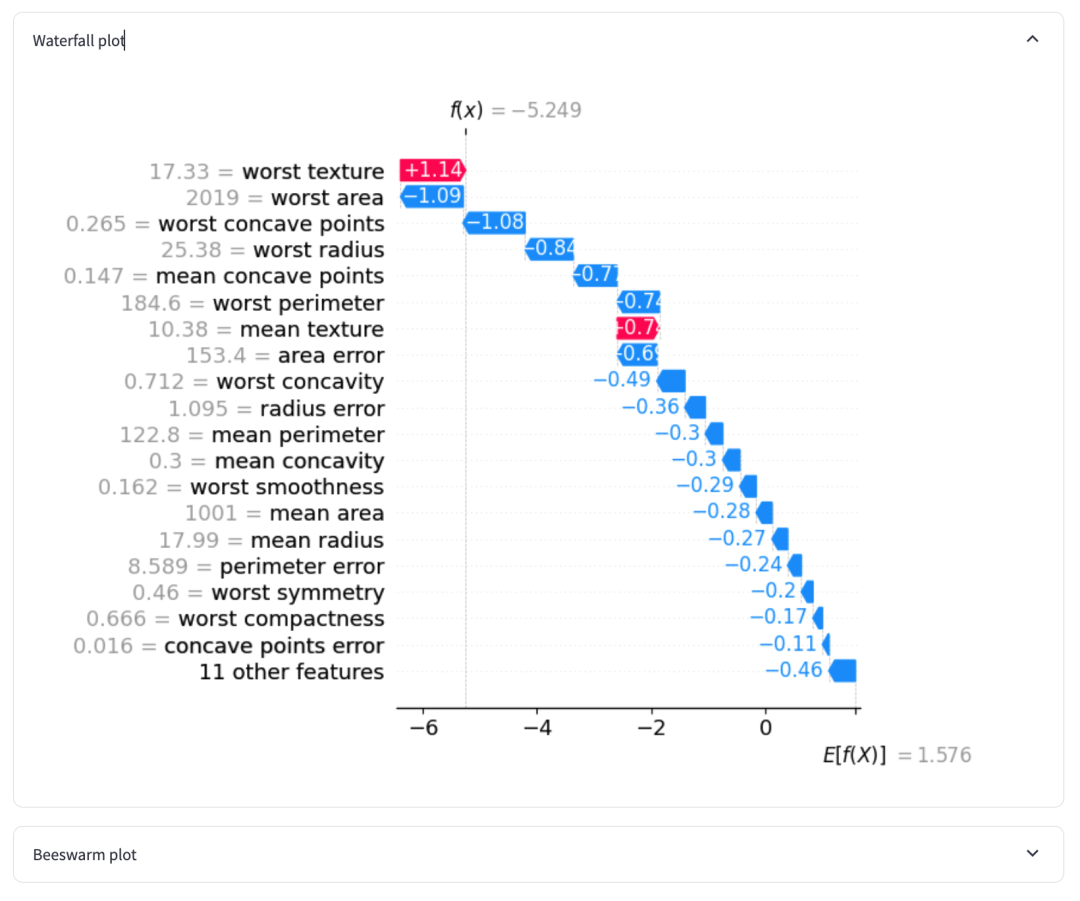

2. Waterfall Plot(瀑布图)

3. Force Plot(力图)

4. Dependence Plot(依赖图)

项目功能

本项目是一个通用的 SHAP 可视化工具,专门设计用于展示和解释机器学习模型的预测结果。我们使用乳腺癌数据集作为示例,但这个工具可以应用于任何二分类预测任务。

支持密码保护

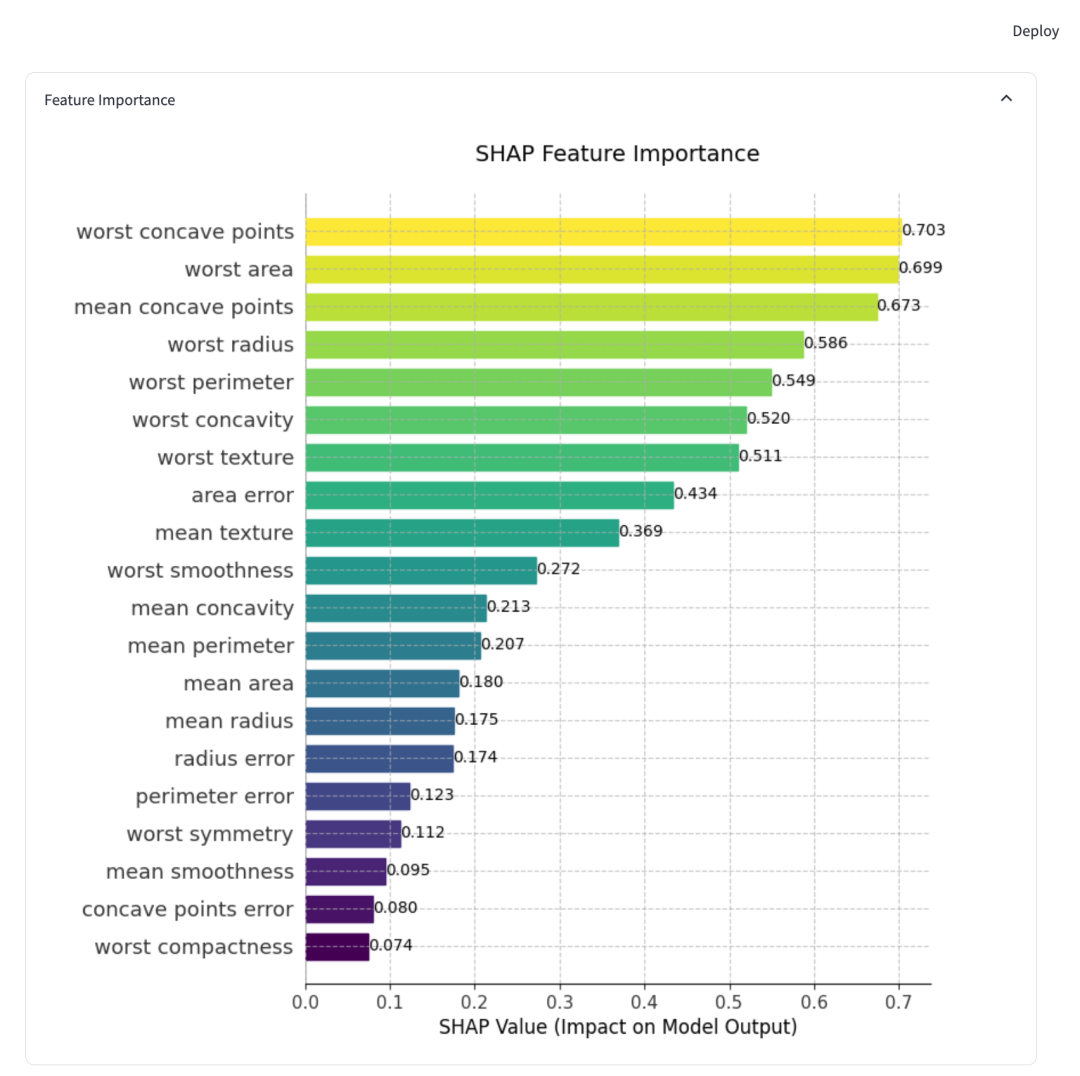

1. 特征重要性可视化

- 适当的图表大小和间距

2. 模型解释图表

- 直观理解预测过程

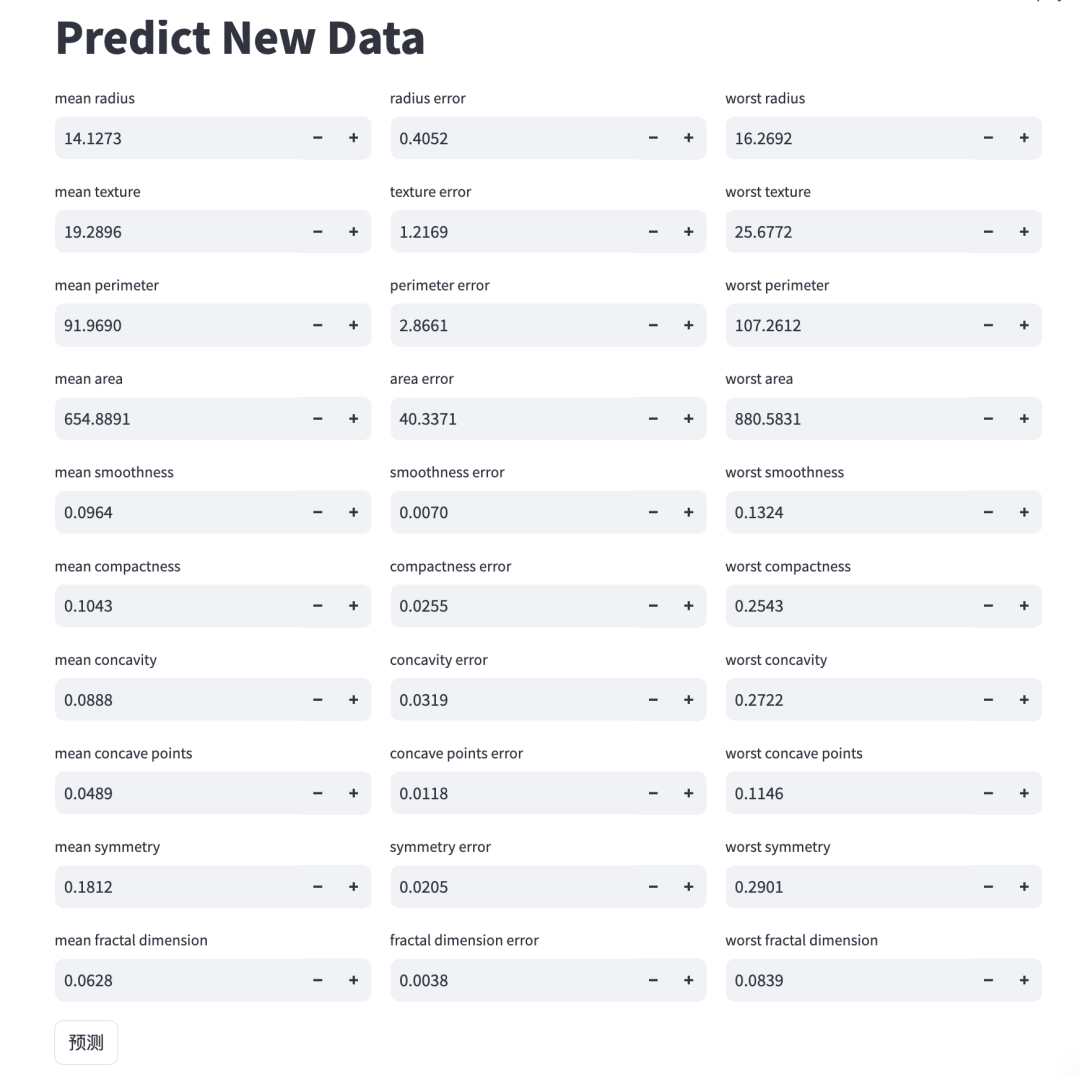

3. 交互式预测功能

-

默认值自动填充

使用预训练模型

本项目支持使用预训练模型,特别是对于已经训练好的模型文件(如 .cbm 格式的 CatBoost 模型)。

以下是详细的使用说明:提供手把手教学