AI搜索落地的挑战

在过去一年中,基座大模型技术的快速迭代推动了 AI 搜索的演进,主要体现在以下几个方面:

搜索技术链路重构

基于大模型的全面重构正在重塑 AI 搜索的技术链路。从数据采集、文档解析、向量检索到查询分析、意图识别、排序模型和知识图谱等各个环节,都在经历深刻变革。新的交互方式如对话式搜索、答案总结、智能客服、企业数字员工和虚拟人逐渐成为主流,不仅提升了用户体验,也为更多应用场景提供了可能。

AI 搜索作为基础设施

AI 搜索已成为各类 AI 应用的基础技术之一。作为热门的 AI 原生应用,它不仅驱动了知识类 AI 应用的发展,还逐步成为各大基础模型的内置能力。例如,向量检索、检索增强生成(RAG)和语义搜索等技术已在多个领域广泛应用。这种集成化趋势增强了 AI 搜索在不同场景下的适应性和灵活性。

效果提升面临的瓶颈

尽管 AI 搜索在效果上取得了显著进步,但幻觉问题仍是制约其广泛应用的主要因素,尤其在对知识准确性要求极高的业务场景中更为突出。此外,高成本和隐私安全可控性低也是实施过程中面临的重要挑战。

为应对这些问题,阿里云 Elasticsearch 推出了创新的 AI 搜索方案,使用 RAG 技术对检索增强生成的各个环节进行能力增强,并深度融合了企业版 AI Assistant,将 RAG 技术应用于 AIOps 领域。

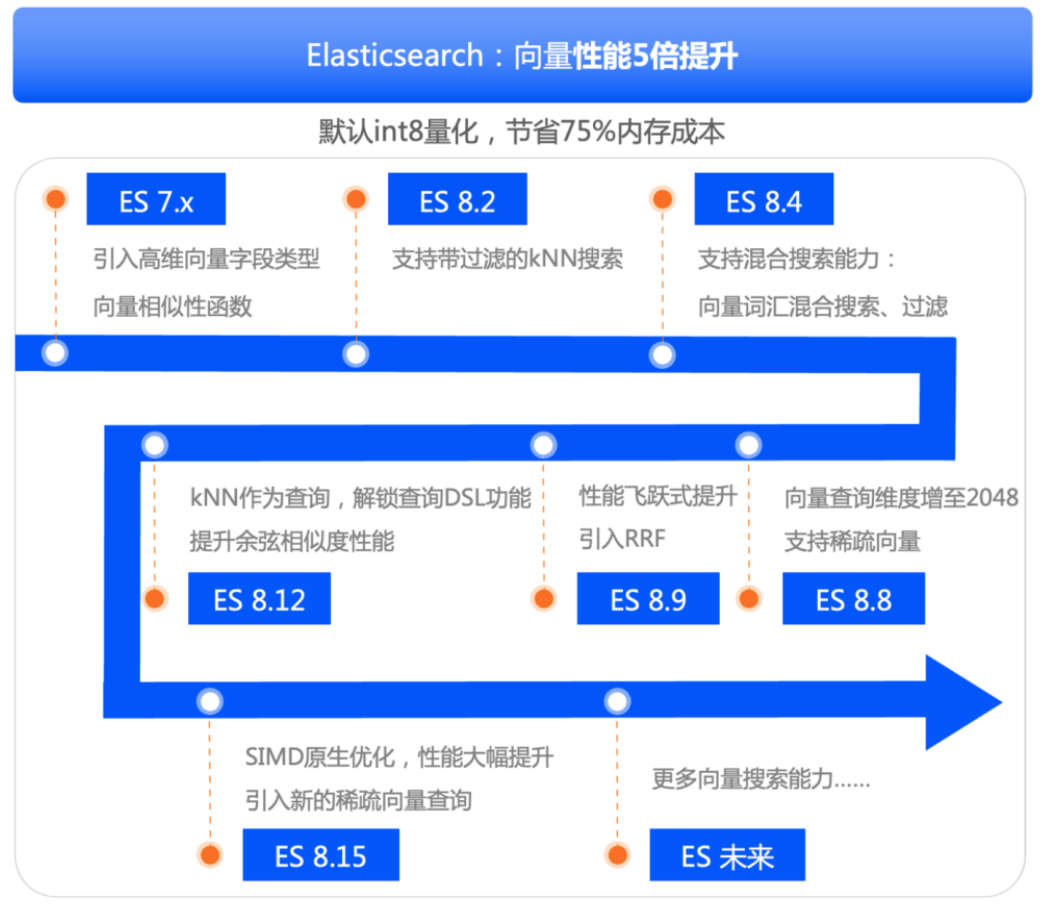

Elasticsearch 向量性能5倍提升

Elasticsearch 向量引擎持续优化,特别是针对性能与成本的改进尤为突出。初期,由于普遍存在的认知偏差——认为 ES 向量引擎虽功能强大但在性能上可能存在短板,尤其是对于 Java 生态系统中的应用——这一观点正逐渐被其技术演进所颠覆。自8.0初始版本至已经迈入的8.15版本的历程中,Elasticsearch 不断迭代,特别是在性能优化方面取得了显著进展,其中包括但不限于对硬件加速技术的有效整合。

Elasticsearch 利用硬件加速技术在向量检索领域,尤其是处理复杂相似度计算任务时,实现了显著的性能飞跃。这种技术创新不仅限于理论层面,实践证明,通过硬件加速器的深度融合,部分计算密集型操作的效率提升了数倍乃至更多。例如,从2022年9月至今的基准测试数据可直观看出,查询响应时间从最初100ms大幅缩减至现在20ms左右,彰显了 Elasticsearch 向量检索迭代升级带来的巨大性能提升。

Elasticsearch在内存优化同样值得关注,通过向量量化技术,所需内存仅为原先需求的四分之一,极大提升了资源利用率。在最新的版本中,BBQ(Better Binary Quantization)为Elasticsearch 在量化方面带来一次飞跃,将 float32 维度缩减为位,在保持高排名质量的同时减少约 95% 的内存。BBQ 在索引速度(量化时间减少 20-30 倍)、查询速度(查询速度提高 2-5 倍)方面优于乘积量化 (Product Quantization - PQ) 等传统方法,并且不会额外损失准确性。

Elasticsearch 企业版 AI 能力全面解读

语义扩展与稀疏向量表示:

Elasticsearch 利用诸如稀疏编码技术,不仅能够基于原始词汇建立索引,还能有效扩展至与其相关的概念或词汇,每项扩展均附有模型计算出的权重,增强了语义理解的深度和广度。这得益于稀疏向量技术,它以较低内存占用高效存储信息,对比稠密向量需全内存索引,显著提升了资源效率。

查询效率与资源优化:

查询过程受益于倒排索引结构,避免了向量相似度匹配的开销,加速了检索速度。此外,Elasticsearch 的稀疏向量减少了内存需求,进一步优化了资源利用。

混合搜索策略:

现代搜索需求促使 Elasticsearch 支持多模态查询,结合文本、向量检索以及rrf混合排序方法,以增强结果的相关性和覆盖范围。这种混合搜索策略能够召回更多样化的数据,提升用户体验。

排名与相关性调整:

为了从召回的大量数据中精确选出最相关的结果,ES 采用如BM25等排序机制,考虑文档频率和位置等因素初步确定权重。随后,通过集成学习或更精细的模型(如Rerank阶段)对初步筛选出的文档进行二次排序,确保顶部结果高度相关。

模型集成与原生支持:

Elasticsearch 展现了强大的模型集成能力,允许用户直接将自定义模型加载至集群中运行,实现从输入到输出(如词嵌入生成)的端到端处理,无需外部预处理步骤。这不仅简化了工作

流程,还促进了机器学习模型与搜索引擎的无缝融合,强化了系统的智能化水平和适应性。

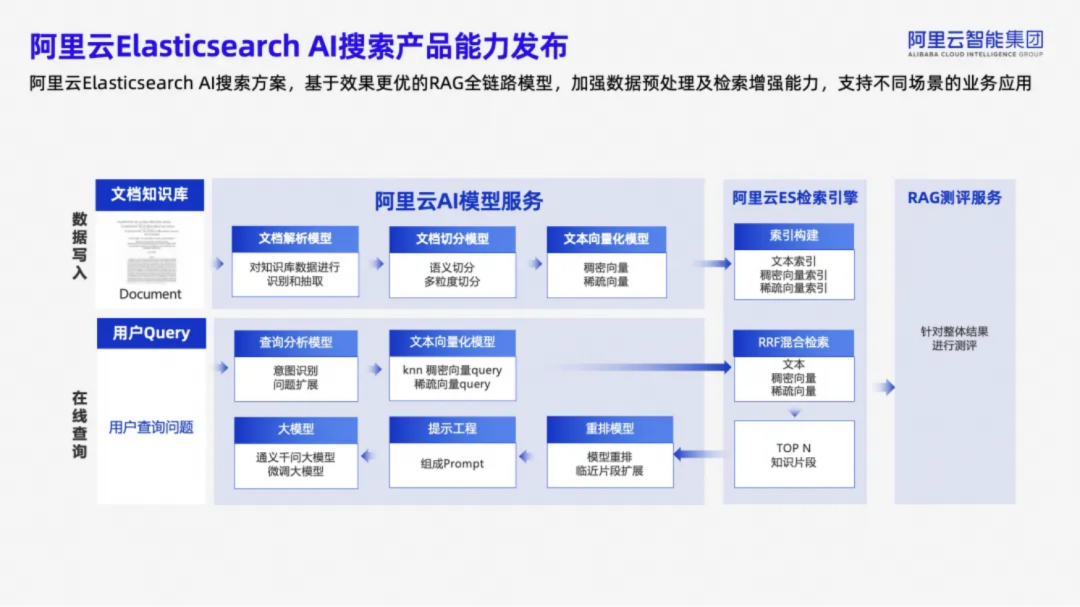

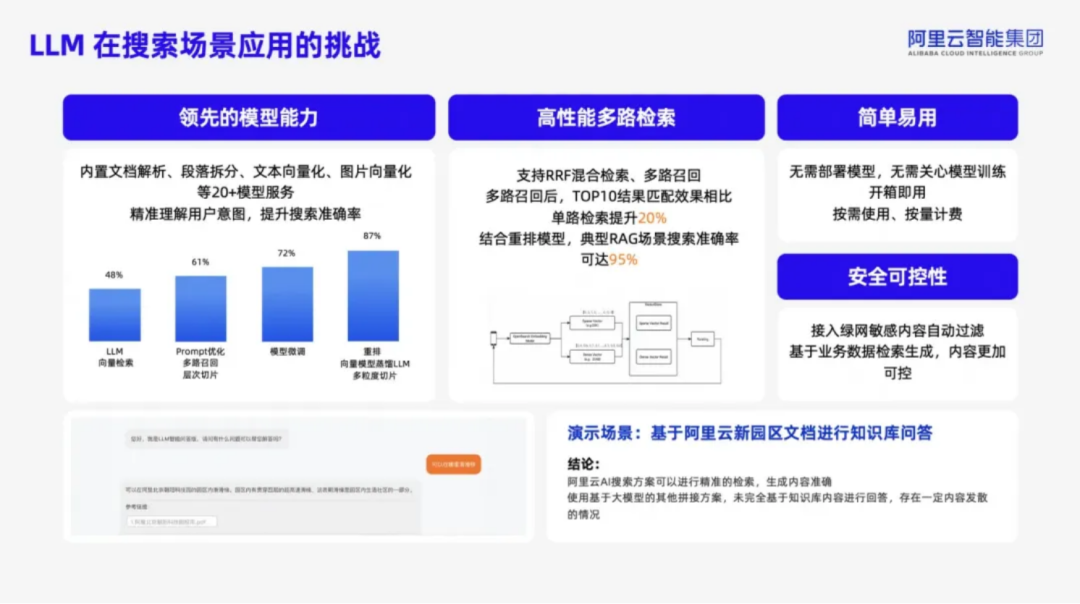

阿里云 Elasticsearch 将准确率提升至95%

阿里云 Elasticsearch AI 搜索产品依托于强大的 Elasticsearch 基础,基于阿里云 AI 搜索开放平台,整合多样化模型与混合检索技术,实现了从传统搜索到 AI 语义搜索的跨越。该方案通过精细的数据预处理、智能向量化、多维度检索召回、以及大模型辅助生成,形成了一个完整且高效的 RAG 场景应用框架。

文档解析与切分:利用自研模型识别非结构化数据,提取关键信息,保证内容的完整性和语义连贯性。

高效向量化:采用参数量优化的向量模型,在保证效果的同时降低成本,实现向量化过程的高效执行。

RRF混合检索策略:结合文本、稀疏及稠密向量索引,实现多路召回,大幅提升检索精度与效率。

意图理解与重排优化:通过查询分析模型理解用户意图,配合重排模型对结果进行精排序,确保内容的相关性。

综合测评与灵活配置:AI搜索开放平台台提供一站式服务,包含多款模型组件,兼容开源生态,助力企业快速搭建定制化搜索系统。

通过阿里云 Elasticsearch AI 搜索的全面应用,客户在知识库问答场景中见证了显著成效,准确率从最初的48%提升至最终超过95%。此外,三路混合检索与重排模型的结合,进一步提升了检索的精确度,保障了搜索体验的卓越性。

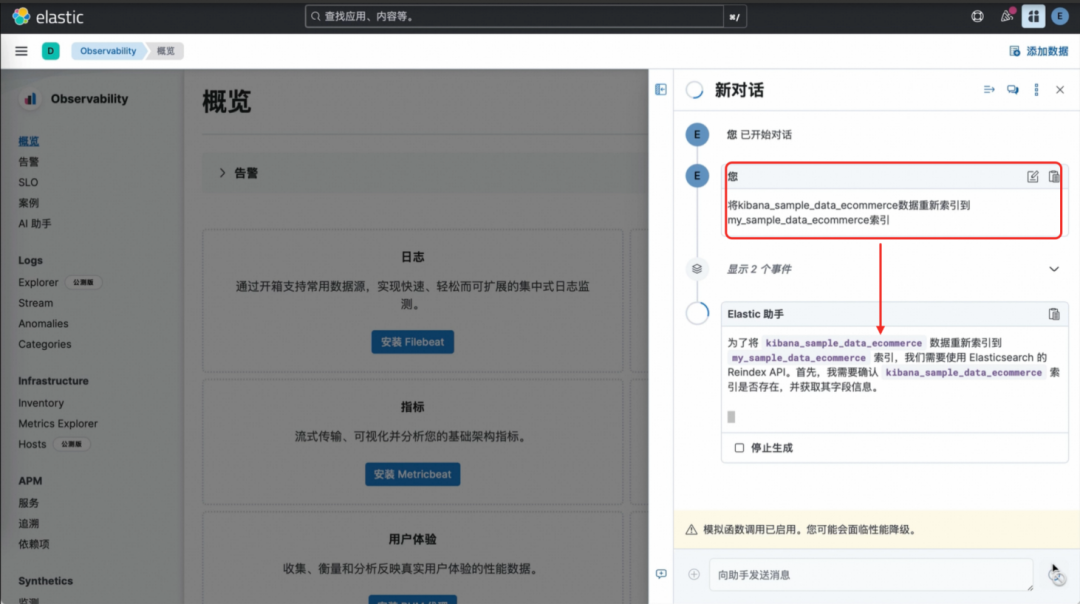

AI Assistant 集成通义千问大模型实现 AI Ops

Elasticsearch 企业版的 AI Assistant 融合了 RAG 技术和阿里云大模型服务,为企业提供了 AI Ops 助手。这一创新工具在通用搜索、可观测性分析及安全保障等多个领域展现出了卓越的应用潜力,不仅能够助力开发者在异常监控、警报处理、问题识别与诊断、数据分析建模以及查询性能优化等方面取得显著进展,还通过更加直观易用的交互界面极大提升了工作效率。

特别是在可观测性方面,AI Assistant 借助于自动化的函数调用机制,该助手能够高效地请求、分析并可视化您的数据,将其转化为具有实际操作价值的信息。此外,基于 Elastic Learned Sparse EncodeR (ELSER) 支持的知识库进一步丰富了来自私有数据集中的上下文信息和建议;而 RAG 技术与通义大模型相结合,则确保了更精准的数据理解和表达能力。

通过阿里云 AI 搜索开放平台上集成通义千问大模型后,Elasticsearch 的 AI Assistant 特别注重激活函数模拟调用,以保证不同系统间的无缝兼容。这使得用户可以根据具体需求灵活切换多种连接器,从而实现高效的信息检索与处理流程。尤其在微服务运维场景下,AI Assistant 发挥着至关重要的作用——它不仅能实时监测异常状况与潜在故障点,还能对详细的错误日志进行深入剖析,并结合现有运维手册快速定位问题根源。与此同时,AI Assistant 还能有效整合各类告警信息,对安全攻击链条进行全面分析,进而提出切实可行的防御策略,显著提高了问题解决的速度与质量。

通过调用 API 接口并自动生成 ESQL 查询语句,AI Assistant 能够执行复杂的数据分析任务并生成直观易懂的统计图表,即使是对 Elasticsearch 查询语法不甚了解的用户也能轻松上手。无论是探究字段间的关系,还是解读数据趋势等数据洞察,AI Assistant 都能以极高的效率和便捷的操作方式满足用户的多样化需求。