每日精选 GitHub 上优质开源项目,涵盖文档、AI、浏览器扩展、多模态模型、支付、代码代理、自然语言处理、推理引擎等领域,助力开发者提升效率、创新产品。

1.GitHub 文档开源仓库

🏷️仓库名称:github/docs

🌟截止发稿星数: 16710 (今日新增:11)

🇨🇳仓库语言: TypeScript

🤝仓库开源协议:Creative Commons Attribution 4.0 International

🔗仓库地址:https://github.com/github/docs

引言

本文将深入介绍 GitHub 文档开源仓库,概述其用途、技术解析和使用建议。

项目作用

GitHub 文档团队将预生产内容保存在私有仓库中,并定期与该公共仓库同步。文档以 Markdown 格式编写,并使用 Jekyll 静态站点生成器构建。

仓库描述

此仓库包含 docs.github.com 网站的文档源代码和 Markdown 文件。

案例

该仓库用于托管 GitHub 产品的文档,如 GitHub Actions、GitHub Pages 和 GitHub Security。

客观评测或分析

该仓库是一个宝贵的资源,可获取 GitHub 产品的最新和准确文档。它提供了全面且组织良好的信息,并易于导航和搜索。

使用建议

开发者、用户和技术作家可以使用该仓库:

结论

GitHub 文档开源仓库是 GitHub 产品文档的一个全面且有价值的来源。它提供了易于获取和使用的最新文档,并欢迎贡献和改进。

2.Amazon Bedrock 样例仓库

🏷️仓库名称:aws-samples/amazon-bedrock-samples

🌟截止发稿星数: 753 (今日新增:6)

🇨🇳仓库语言: Jupyter Notebook

🤝仓库开源协议:MIT No Attribution

🔗仓库地址:https://github.com/aws-samples/amazon-bedrock-samples

引言

本仓库提供了 Amazon Bedrock 服务的样例,旨在帮助客户快速入门并探索其功能。

项目作用

此仓库包含以下样例:

仓库描述

此仓库随附一个 README 文件,其中包含有关每个样例的详细信息以及如何开始使用它们的说明。

案例

此仓库提供以下类型的样例:

预构建的 Jupyter Notebook

代码示例

文档

客观评测或分析

此仓库提供了全面的 Amazon Bedrock 指南,涵盖了该服务的主要特征和功能。样例易于理解和使用,使开发者能够快速入门并开始构建自己的生成式 AI 应用程序。

使用建议

对于希望探索生成式 AI 潜力的开发者和数据科学家来说,此仓库是一个宝贵的资源。样例可以帮助开发者了解 Bedrock 的功能,并为构建自己的应用程序提供灵感。

结论

Amazon Bedrock 样例仓库为使用 Amazon Bedrock 服务提供了一个宝贵的起点。通过提供的样例,开发者可以深入了解该服务的可能性,并开始构建自己的生成式 AI 应用程序。

3.Page Assist:提升浏览体验的本地 AI 助手

🏷️仓库名称:n4ze3m/page-assist

🌟截止发稿星数: 2252 (今日新增:103)

🇨🇳仓库语言: TypeScript

🤝仓库开源协议:MIT License

🔗仓库地址:https://github.com/n4ze3m/page-assist

引言

Page Assist 是一款开源浏览器扩展,旨在通过侧边栏和 Web UI 将本地 AI 模型集成到您的浏览体验中,让您随时随地与 AI 交互。

项目作用

仓库描述

Page Assist 仓库包含:

源代码、构建文件和文档。

问题跟踪器和讨论论坛。

贡献指南和许可证信息。

案例

用户可以使用 Page Assist:

在网上冲浪时寻求信息和帮助。

从网页中提取关键信息和见解。

总结或翻译长篇文本。

客观评测或分析

Page Assist 是一种有价值的工具,可以增强您的浏览体验,并为您提供以下优势:

无需访问外部网站即可与 AI 交互。

隐私得到保障,因为数据存储在本地。

可定制,支持各种本地 AI 提供商。

使用建议

结论

Page Assist 是一款功能强大的浏览器扩展,将本地 AI 的便利带入了您的浏览体验。它提供了一个用户友好的界面,让您在网上冲浪时可以随时与 AI 助手进行互动,从中受益。

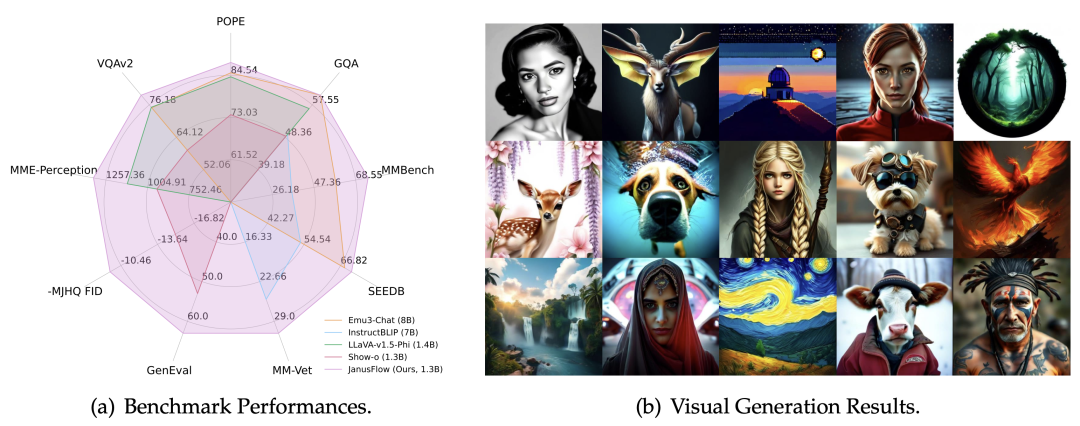

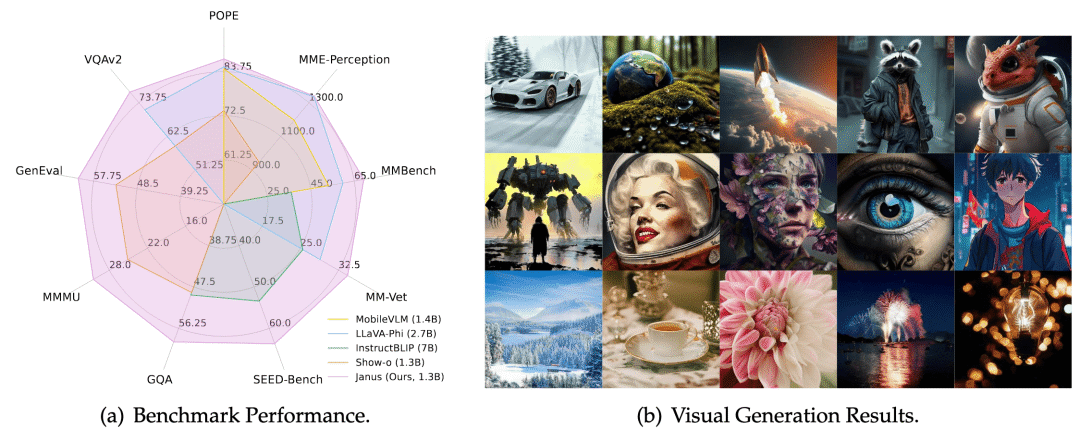

4.Janus:一个统一的多模态理解与生成模型

🏷️仓库名称:deepseek-ai/Janus

🌟截止发稿星数: 12489 (今日新增:3045)

🇨🇳仓库语言: Python

🤝仓库开源协议:MIT License

🔗仓库地址:

https://github.com/deepseek-ai/Janus

引言

这篇文章探讨 了Janus,一个统一多模态理解和生成模型的系列。我们将介绍Janus的不同版本,包括Janus-Pro、Janus和JanusFlow,描述它们的创新和应用程序。

客观评测或分析

Janus系列模型在多模态理解和生成任务的基准测试中取得了最先进的结果。

使用建议

研究人员和开发人员可以使用Janus系列模型来构建自己的多模态应用程序。

企业可以使用这些模型来增强其产品和服务,例如聊天机器人、搜索引擎和内容生成工具。

教育者可以使用这些模型来教授多模态学习和生成模型。

结论

Janus系列模型代表了统一多模态理解和生成领域的最新进展。这些模型具有强大的性能、灵活性和大规模部署的潜力。随着该领域的发展,我们期待看到Janus系列模型的进一步创新和应用。

5.Polar:开源商家记录(Merchant of Record)

🏷️仓库名称:polarsource/polar

🌟截止发稿星数: 3987 (今日新增:191)

🇨🇳仓库语言: Python

🤝仓库开源协议:Apache License 2.0

🔗仓库地址:https://github.com/polarsource/polar

引言

Polar是一个开源的货币化平台,旨在为开发人员提供一站式资助和货币化解决方案。

仓库描述

该项目包含Polar平台的后端和前端应用程序,使用Python、FastAPI、Arq、SQLAlchemy(PostgreSQL)、Redis和Next.js等技术。

客观评测或分析

Polar是一个强大的工具,可以帮助开发人员专注于构建产品,而无需担心支付和货币化基础设施。

结论

Polar为开发者提供了一个灵活、实惠且易于使用的平台,可以从他们的数字产品和服务中获利。

6.codename goose:扩展式 AI 代理,超越代码建议

🏷️仓库名称:block/goose

🌟截止发稿星数: 2793 (今日新增:746)

🇨🇳仓库语言:

Rust

🤝仓库开源协议:Apache License 2.0

🔗仓库地址:https://github.com/block/goose

引言

codename goose 是一个开源且扩展性的 AI 代理,它超越了传统的代码建议功能,支持安装、执行、编辑和测试任何大型语言模型 (LLM)。

项目作用

codename goose 采用 Rust 语言开发,支持多种大型语言模型,包括 ChatGPT、GPT-3 和 BLOOM。它通过一个插件系统与 IDE(例如 VSCode)集成,允许用户在代码编辑器中直接访问 LLM 功能。

仓库描述

该仓库提供有关 codename goose 的信息,包括安装说明、使用指南和贡献指南。

客观评测或分析

codename goose 因其以下优势广受好评:

使用建议

对于希望提高生产力和增强编码能力的程序员来说,codename goose 是一个有价值的工具。 它特别适用于从事复杂项目或探索新技术的人员。

结论

codename goose 是一个变革性的工具,它通过将 LLM 的强大功能带入编码工作流程,为程序员提供了全新的可能性。其开源性质和可扩展性使其具有无限的潜力,成为代码开发和创新的未来。

7.Qwen2.5:一个功能强大且用途广泛的大型语言模型

🏷️仓库名称:QwenLM/Qwen2.5

🌟截止发稿星数: 12813 (今日新增:299)

🇨🇳仓库语言: Shell

🔗仓库地址:https://github.com/QwenLM/Qwen2.5

引言

Qwen2.5是阿里云Qwen团队开发的先进大语言模型(LLM)。该模型旨在帮助处理各种需要自然语言理解和生成功能的应用。

项目作用

Qwen2.5 是一个基于 Transformer 的架构,该架构在海量文本和代码数据集上进行训练。通过该训练,模型对自然语言有了深入理解,可高精度执行各种任务。

仓库描述

Qwen2.5 存储库包含以下内容:

客观评测或分析

独立评估表明,Qwen2.5 在以下方面表现出色:

在一系列任务上优于先前的 LLM

在生成较长连贯文本方面特别有效

对结构化数据有很强的理解力,可以生成结构化输出

使用建议

若要使用 Qwen2.5,可执行以下操作:

结论

Qwen2.5 是一款功能强大且用途广泛的 LLM,可显著增强自然语言处理应用的功能。它出色的性能和易用性使其成为研究人员、开发人员和企业的有价值工具。

8.vLLM:高效且易用的 LLM 推理和服务引擎

🏷️仓库名称:vllm-project/vllm

🌟截止发稿星数: 35550 (今日新增:163)

🇨🇳仓库语言: Python

🤝仓库开源协议:Apache License 2.0

🔗仓库地址:https://github.com/vllm-project/vllm

引言

vLLM 是一个用于 LLM 推理和服务的快速且易于使用的库,专门设计为高吞吐量且内存效率高,旨在简化和加速 LLM 的部署和使用。

项目作用

vLLM 使用多种技术来实现其高性能,包括:

PagedAttention:一种用于高效管理注意键和值内存的创新技术

连续批处理:连续批处理传入请求以优化吞吐量

快速模型执行:使用 CUDA/HIP 图进行快速模型执行

量化:使用 GPTQ、AWQ、INT4、INT8 和 FP8 进行量化以减少内存使用和提高效率

优化内核:使用 FlashAttention 和 FlashInfer 集成的优化 CUDA 内核

仓库描述

vLLM 项目是一个活跃且不断发展的社区,欢迎贡献。

案例

vLLM 已在多个项目中使用,包括:

客观评测或分析

vLLM 的性能基准显示出与其他 LLM 服务引擎相比具有显着的速度优势。

使用建议

vLLM 安装简单,集成容易。有关更多详细信息,请参阅项目文档。

结论

vLLM 为 LLM 推理和服务提供了一种高效且经济的方法,使其成为各种应用程序的宝贵工具。其活跃的社区和持续的发展确保了它的长期支持和创新。

感谢您的观看!别忘了点赞、收藏和分享哦!❤️ 你的支持是我最大的动力!😊 每天为你带来不一样的开源项目!