过去十年间,使用机器学习(ML)的商业应用程序激增。同样,无线通信时延和带宽的显著改善也促使云连接设备迅速普及,并获得了物联网(IoT)的称号。有了这种技术,就能将智能添加到传感器系统和设备中,使亚马逊Echo、谷歌Nest和其他相关的“智能设备”等新技术成为可能。然而,这些设备只是提供了智能的假象,它们仅仅是通过集中式云基础设施提交和接收查询的工具。这种云处理方式引发了人们对用户数据存储位置、可能用于哪些其他服务以及谁能访问这些数据等问题的担忧。

最近,物联网和机器学习领域的融合取得了进展,智能技术可以直接应用到设备上,该项技术被称作微型机器学习(TinyML)。与传统的基于云的物联网架构相比,TinyML有几个优势,因为这些设备的性能取决于延迟和带宽。例如,无线通信的功耗很高,是放大天线信号所需的电流所致。此外,潜在的敏感数据被远距离广播,这为恶意行为者拦截数据提供了机会。相比之下,TinyML可以在设备上处理数据,这意味着无须进行无线通信。这种离线设备可以提高安全性、降低功耗,并仅为固件更新或通信异常保留通信。然而,这种新的ML范式遇到了与物联网工作流程类似的挑战,其中最突出的是数据隐私和对更高透明度的需求。

这些挑战可以通过示例得到最好的说明,比如TinyML的一个日常用例,即人员检测——确定图像中是否有人存在。人们可以想象在家中安装“人员探测器”控制照明或其他家用系统。人员探测器的关键数据生成设备是摄像头,其数据随后被提交给应用处理器,并通过存储在闪存中的神经网络运行。网络的输出是一个简单的二分类结果,显示是否有人存在。

在当前基于云的物联网部署中,虽然此类设备的二分类输出可能不包含大量敏感信息,但无法保证这些设备收集的原始图像不会被获取并用于其他目的,尤其是可能不怀好意的目的。我们可以想象,这些图像可能会被用来确定一栋房子里住了多少人,他们的种族、性别、习惯等,所有这些都是基于以人员检测为幌子获取的数据。这些因素引起了隐私权倡导者、终端用户和工会的关注。不幸的是,这并不是一个孤立的问题,许多较新的设备都在用户不知情的情况下安装了麦克风或摄像头。这一趋势突出表明,有必要提高透明度,引入法规或机制来保护用户隐私,并告知用户其设备正在收集哪些数据。

为此,我们提出了ML传感器,这是一个用于开发支持ML的嵌入式系统的逻辑框架,通过其隐私设计方法为最终用户提供支持。通过限制数据接口,ML传感器范式有助于确保超出传感器功能范围的用户信息不被提取。我们定义ML传感器是一个独立的嵌入式系统,它利用机器学习在设备上处理传感器数据,在逻辑上将数据计算与主应用处理器解耦,并将更广泛的系统的数据访问限制为高级ML模型输出。

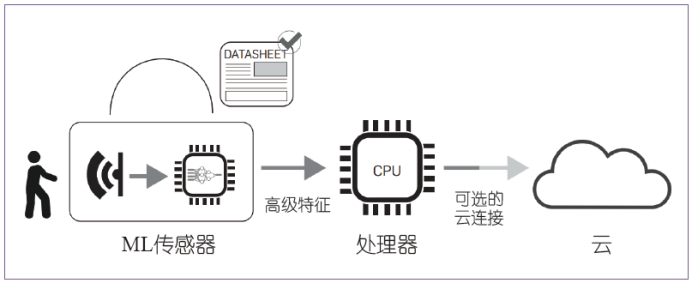

ML传感器背后的基本思想是将ML处理器与传感器耦合在一起,并作为独立于中央处理器的单个物理实体的一部分(见图1)。与计算机科学中用户空间和内核空间的区别类似,这两个处理器将工作在完全不同的世界中。中央处理器无法访问所有数据,只能接收来自ML传感器的输出。另一方面,ML传感器可以访问数据,但只包含执行基本操作的功能和外围设备,没有其他辅助计算。因此,原始传感器的数据永远不会离开ML传感器,从而在实现智能的同时提高隐私性。

图1 ML传感器范式。ML模型与物理传感器紧密耦合,与ML传感器中的应用处理器分离。这种范式将数据级计算与更广泛的系统隔离开,避免了对敏感用户数据的系统级访问

例如前文提及的人员探测器,可以通过传递一个表示图像中是否有人物的二分类标签来实现。这种方法可以由一个简单的硬件设计实现,只需三个通信引脚:一个接地,一个供电,一个用于神经网络的二分类输出。如果传感器需要的输出变量不只一个比特,例如用于多分类,则需要更多通道,但只要足够覆盖机器学习输出的共域(co-domain)即可。因此,虽然ML传感器最适用于具有有限模型输出集的应用,但仍可用于从语音命令界面到模拟显示监控等多种可能的商业场景。Useful Sensor公司最近开发了一种人员检测ML传感器模块,其工作原理与我们的示例类似。

为了进一步提高隐私性,在生产过程中可以将ML学习模型加载到ML传感器上,无须硬件功能实现模型更新。或者,还可以加入安全网络功能,确保设备的固件和模型仍可更新,但更新只能在极少数情况下通过无线方式进行。此外,ML传感器还可以采用现有的隐私保护技术(例如SGX和TrustZone)。然而,目前属于TinyML范围内的大多数设备受资源限制,无法实施此类技术。

ML传感器还具有其他值得期待的功能。该设备是独立的模块化设备,可以轻松地与嵌入式系统连接。这种方法使开发支持ML的嵌入式设备不再需要硬件、软件和ML方面的专业知识,从而让非专业人员更容易掌握这项技术。这些设备还可以集成到更大、更复杂的系统中,以实现高级功能,同时为用户提供保护其敏感数据的保证。

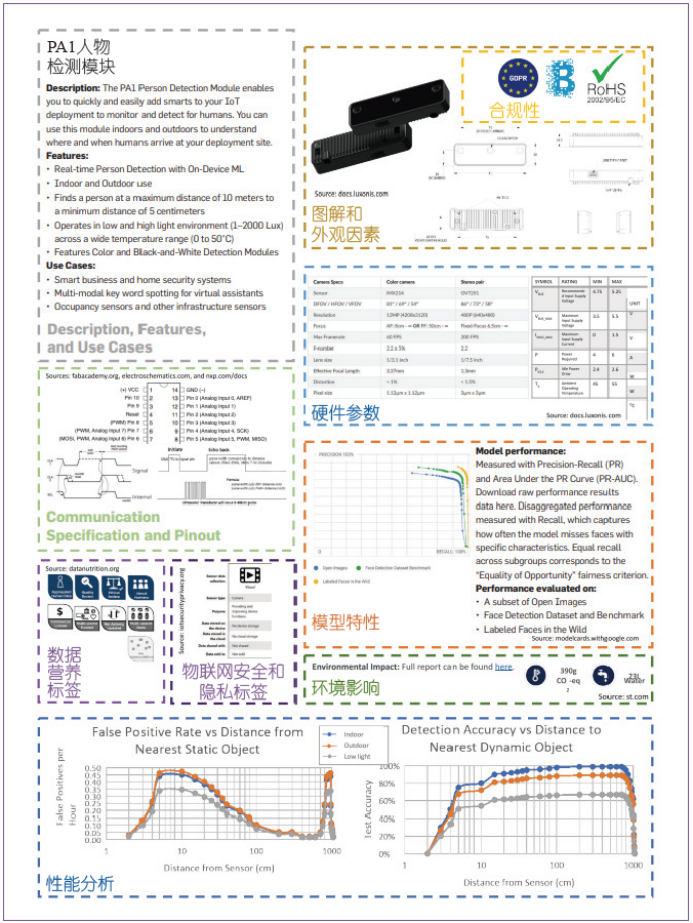

在提供ML传感器的同时,还需要提供一份数据表,说明其核心特征,以确保易于使用。受格布鲁(Gebru)等人的启发,该数据表应包括传统传感器数据表中有的部分(如电气特性),以及概述ML模型性能、端到端性能分析的附加部分,并阐明有关隐私、道德和环境考虑因素的特征,包括用于训练的数据集。这样的数据表可以被审计,以确保其满足有关算法偏差、设备可靠性和性能验证的特定要求。它不仅能为设备设计者提供相关信息,还能在增加透明度和第三方实体验证的基础上,帮助提高公司与最终用户之间的信任度。

图 2 ML传感器数据表的说明性示例

图2是前文提及的人员探测器模块的ML传感器数据表示例。设计此类数据表需要社群的参与和介入,因为它会影响到各个层面的利益相关者,包括最终用户、制造商、技术专家、隐私倡导者、审计机构和政策制定者。ML传感器生态系统需要决定:

• 在用户购买使用ML传感器的设备时,需要向最终用户传达哪些高级信息,例如设备包含哪些传感器以及它收集的数据出于什么目的(即数据营养标签)。

• 使用ML传感器的制造商和企业必须符合哪些道德或合规标准(如GDPR、RoHS)。

• 数据表中应该传达哪些类别和信息,以及应如何传达。

我们相信,提高ML在硬件应用中的可用性产生的净影响(net impact),及其可能对隐私、安全和透明度产生的下游(downstream)影响都将是积极的。然而,与任何方法一样,这种范式也存在挑战,净积极影响取决于开发人员在设计和开发ML传感器时考虑适当的道德因素。例如,传统的ML问题依然存在,如模型偏差、对抗性攻击的可能性以及设备功能的可解释性降低。此外,ML传感器还有可能被恶意利用,如用于武器装备或压制言论自由。基于这些缺点,我们希望这些设备将用于增强现有系统,而不是取而代之,尤其是对于安全关键型应用。也许有一天,人们可能会走进一家五金店,购买人体检测传感器,就像今天购买体温计一样。

智能传感器的飞速发展意味着本文所述挑战将比大多数人预期的出现得更快。有必要采用“隐私设计”的方法主动、及时地解决这些问题。与此同时,公众、企业、制造商和政策制定者之间也需要进行对话,以确定适当的隐私、安全和透明度水平,从而满足各方的需求,以及如何实现这些需求。解决方案包括开发审计系统、认证程序、监管机构,或将这些机制与其他机制结合起来。必须注意确保用户隐私和安全得到保护,同时避免扼杀创新。基于云的ML中也有类似的道德问题,我们或许可以从中汲取经验,同样,为嵌入式ML制定的解决方案,也可以应用到基于云的ML领域中。

(本文译自Communications of the ACM, “Machine Learning Sensors”,2023, 66(11): 25-28一文)

彼得·沃登(Pete Warden)

斯坦福大学博士生,美国加利福尼亚州山景城Useful Sensors公司首席执行官。pete@petewarden.com

马修·斯图尔特(Matthew Stewart)

哈佛大学博士后研究员。matthew_stewart@g.harvard.edu

布莱恩·普兰彻(Brian Plancher)

哥伦比亚大学巴纳德学院计算机科学助理教授。

bplancher@barnard.edu

其他作者:Sachin Katti、Vijay Janapa Reddi

林俊宇

CCF 杰出会员,CCCF 译文编委。中国科学院信息工程研究所高级工程师。主要研究方向为人工智能安全和科技伦理。

linjunyu@iie.ac.cn

刘 锦

中国科学院信息工程研究所博士生。主要研究方向为生成式人工智能。liujin@iie.ac.cn